카메라, 레이더, 라이다의 각 특징들을 상호보완하기위해 센서 퓨전을 이용함

<센서 퓨전의 방식>

1. Central-level

어떤 tracking 시스템이 센서의 원시 데이터(low level )들을 받아서 트래킹함

장점 : 원시 데이터를 사용해 좋은 성능

단점 : 제조 후 다양한 센서들을 사용하기 어려움, 센서가 바뀌면 트래킹 시스템을 사용할 수 없어 재사용성, 확장성이 떨어진다.

2. Sensor-level Tracking & Track-level Fusion

센서가 각각의 트래킹 알고리즘을 가지고 있고 이 결과들을 트래킹 퓨저라는 곳에서 다시 fusion 한다.

[ Track-to-Track (T2T Fusion) ]

최적의 결과는 아니지만 재사용이 가능하고 확장성이 높다.

{X1, P1}, {X2, P2}, ... 각각의 센서

Xn = State, Pn = Covariance

들이 Tracking Fuser, T2T 알고리즘에 들어가게 된다면 하나의 State와 Covariance로 합쳐지게 된다.

X = T2Tx(X1,P1,X2,P2)

P = T2Tp(X1,P1,X2,P2)

<T2T Fusion의 장점>

- Access to data: 원시 데이터를 접근하지 못하는 경우 유리함

-Bandwidth: 다 track된 state, covariance 정보만 전송하게 된다면 적은 bandwidth로 다양한 sensor fusion이 가능하다.

- Compute: 적은 양의 컴퓨팅 파워가 요구된다.

Specialization: 각각의 센서에 적합한 트래킹을 하므로 장점을 얻을 수 있다.

<T2T의 단점>

Reduced accuracy: 정확도가 떨어진다.

Correlate noise: 각 트래킹에서 2개의 확률 분포가 제공된다. 두 트랙이 correlation되어 있지 않은 경우, 불확실성이 감소한다.

<T2T Fusion 알고리즘>

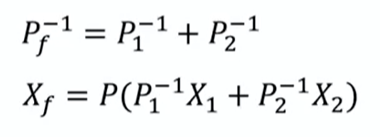

Input: X1, P1, X2, P2 | Output: Xf(Fused State), Pf(Covariance)

1. Kalman Filter

Uncertainty가 작아지고, 두 개의 track이 조건부 독립일 때만 사용이 가능하다.

2. Covariance Intersection

두 부분이 교차하는 지점만 가져온다. 단, Covariance Intersection을 하기 위한 최적화 방식이 요구된다.

두 개의 track이 조건부 독립이 아니면 과장해서 신뢰도를 높이는 fusion을 만들 가능성이 존재한다.

3. Split Covariance Intersection

가장 최근에 나온 방식으로 Independent한 Covariance Matrix와 Dependent한 Covariance Maatrix를 튜닝하여 원하는 위치에 Uncertainty가 놓이게 하는 필터이다.

4. Covariance Union

Uncertainty, Covariance가 커지는 방식이고 보수적인 track fusion

(+) 머신러닝 기반의 센서퓨전

방법1: Early Fusion

- Raw Data에서 Fusion하는 방식

- Point Cloud의 이미지에서 나온 색을 입히는 방식

- 적은 연산량, 직관적인 fusion

- 단점: 두 개의 sensor의 modality가 다를 경우, 성능이 떨어짐

방법2: Middle Fusion

- 센서에서 특정 레이어를 거쳐 feature 추출 후, feature 단위에서 합쳐 네트워크를 구성하는 방식

가장 좋은 성능의 네트워크

방법3: Late Fusion

각 센서의 독립적인 머신러닝 네트워크 결과를 융합

유연한 사용, Modulation 가능

많은 연산량 및 저장 메모리 요구

예를 들자면 Single LiDAR의 단점은

Sparsity로 멀리있는 물체의 포인트 클라우드의 밀집도가 희박하게 검출된다.

Color (RGB) 정보를 미포함하므로 잘못된 classification을 줄 수 있음

이를 해결하기 위해 Camera-LiDAR Fusion

'자율주행 > 이론' 카테고리의 다른 글

| 자율주행 시나리오 (0) | 2024.01.26 |

|---|---|

| 자율주행 시스템을 위한 하드웨어 요구사항 (0) | 2024.01.26 |

| [자율주행] Sensor Calibration- Intrinsic, Extrinsic calibration 설명 (0) | 2023.12.17 |

| [자율주행 자동차공학] Radar: 레이더의 거리, 속도 측정 원리 (0) | 2023.12.16 |

| [Path Planning] 포인트 클라우드 (0) | 2023.03.29 |